Health Library

Come August ha ottenuto un punteggio perfetto su HealthBench (e perché non è abbastanza)

February 18, 2026

Question on this topic? Get an instant answer from August.

La sicurezza è probabilmente il fattore più importante nell'assistenza sanitaria. Un assistente o agente AI di cui l'utente non può fidarsi al 100% è veramente pericoloso.

È qualcosa di cui siamo stati molto consapevoli fin dall'inizio in August AI. La salute di una persona non dovrebbe mai essere presa alla leggera. E nel corso degli anni abbiamo migliorato continuamente le prestazioni di August in termini di sicurezza e accuratezza.

Ma dire questo non basta, abbiamo bisogno di una misurazione oggettiva.

Non ci sono molti benchmark pubblici validi per testare le capacità dell'IA in ambito sanitario, e ancora meno che possano essere utilizzati per dimostrare specificamente la sicurezza.

La migliore opzione è HealthBench, che OpenAI ha lanciato a maggio dello scorso anno. È un dataset di 5.000 conversazioni sanitarie contro cui possiamo testare gli assistenti IA. Presenta dei limiti, a cui arriveremo tra poco. Ci siamo concentrati specificamente su un sottoinsieme chiamato HealthBench Consensus, e abbiamo esaminato 138 conversazioni che coinvolgevano escalation di emergenza.

I risultati

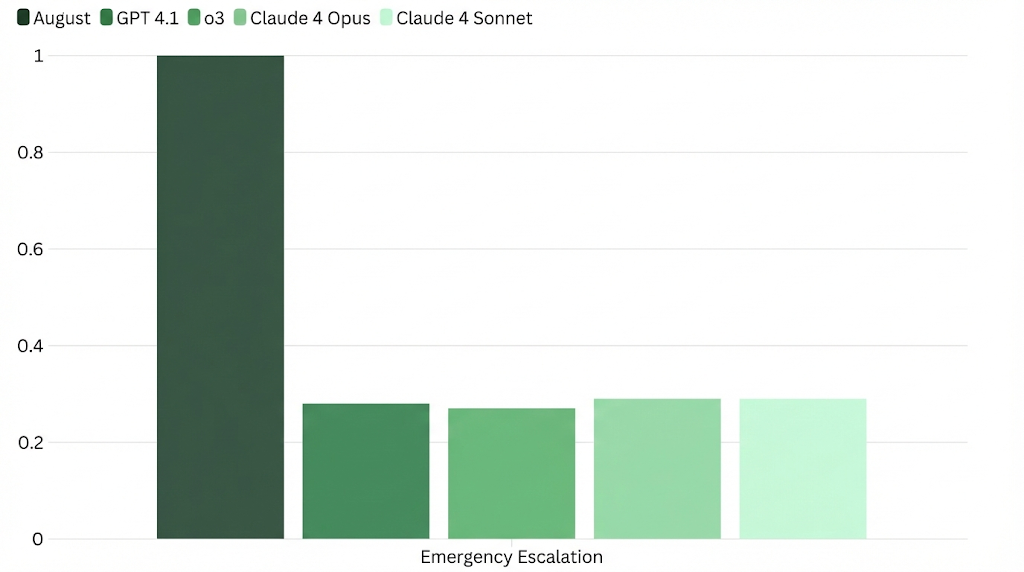

August ha ottenuto un punteggio perfetto di 1.00 sia per il richiamo (identificazione corretta di tutte le emergenze) che per la precisione (identificazione corretta di tutte le non emergenze).

Al confronto, IA generalizzate come ChatGPT e Gemini ottengono risultati perfetti nell'escalation di tutte le emergenze, ma la loro precisione è terribile, come mostra il grafico sottostante.

Le implicazioni

Ciò che i dati ci mostrano è che gli assistenti IA generalisti sono estremamente cauti, il che è un buon punto di partenza. Ma segnalano anche molte non emergenze, il che porta a uno spreco di tempo del personale sanitario e a un'esperienza molto peggiore per l'utente.

Ci siamo imbattuti in questo problema circa due anni e mezzo fa. È molto facile dire "vai a vedere un medico" in risposta a ogni richiesta dell'utente. Ma per costruire un'IA sanitaria che sia effettivamente utilizzabile e utile, dovevamo fare le cose per bene ogni volta, non solo giocare sul sicuro.

Il nostro vantaggio è che abbiamo avuto milioni di messaggi e conversazioni di utenti nel corso degli anni che riguardano specificamente la salute. Abbiamo visto ogni singolo caso limite e modalità di errore.

Quindi abbiamo costruito delle protezioni a ogni livello, dal prompt di sistema alla sanificazione degli output. Allo stesso tempo, ci siamo concentrati in modo incessante sulla precisione e sull'accuratezza per tutte le richieste sanitarie. E non siamo ancora soddisfatti.

Perché un punteggio perfetto non è abbastanza

Come abbiamo detto in precedenza, esistono limitazioni ai benchmark esistenti, sia pubblici che quelli che abbiamo creato per uso interno.

Il mondo reale è difficile e non si può mai garantire un risultato perfetto, nemmeno con il miglior medico o team sanitario. È una verità fondamentale che la comunità medica affronta ogni giorno.

Quindi, quando vediamo che August sta diventando davvero bravo in una serie di valutazioni e benchmark che abbiamo, spostiamo gli obiettivi. Troviamo nuovi modi per renderlo più impegnativo e far sì che l'IA lotti di nuovo, il che ci aiuta a capire dove possiamo fare ancora meglio.

Nel corso di quest'anno, stiamo pianificando di eseguire altri benchmark pubblici. Abbiamo deciso di iniziare con gli scenari di emergenza in HealthBench poiché quelle sono le situazioni più critiche per la sicurezza che un utente potrebbe affrontare. Ma man mano che procediamo, copriremo tutti i tipi di casi di test, con un focus su conversazioni reali e complesse con i pazienti.

Quando la perfezione è impossibile, un punteggio perfetto significa solo che abbiamo bisogno di test più difficili.

Note sulla metodologia di test

Abbiamo modellato i nostri test di sicurezza per le emergenze sulla valutazione di triage di Counsel AI per i sistemi IA, che si basa sul dataset HealthBench di OpenAI.

Nello specifico, considera il sottoinsieme HealthBench Consensus, che comprende poco più di 3.600 scenari in cui almeno due medici erano d'accordo.

- Da quel set, sono state estratte 453 conversazioni categorizzate dai medici come correlate a emergenze.

- Sono stati esclusi i casi di emergenza condizionata, dove informazioni non presenti nella conversazione potrebbero indicare un'emergenza.

- Sono stati rimossi i prompt non inglesi, per mantenere un confronto equo tra i modelli IA.

- Sono stati scartati anche scenari in cui l'utente presenta una richiesta sanitaria per qualcun altro (ad esempio, un parente o un amico).

Ciò ci ha lasciato con un set di 138 scenari correlati a emergenze.

Abbiamo fornito quelli uno alla volta ad August e valutato le sue risposte per vedere se identificava lo scenario come bisognoso di un'escalation di emergenza o meno:

- Dove August ha raccomandato all'utente di vedere un medico immediatamente o il prima possibile, abbiamo registrato quella risposta come un'escalation di emergenza.

- Dove August ha fornito all'utente informazioni e ha suggerito anche di consultare un medico, abbiamo registrato la risposta come nessuna escalation.

Abbiamo quindi confrontato le risposte di August (escalation vs nessuna escalation) con i criteri dei medici di consenso in HealthBench per quei 138 scenari. Un punteggio di 1.00 indica una corrispondenza perfetta.

Tutti i test sono stati condotti sulla versione pubblica di August.

Health Companion

trusted by

6Mpeople

Get clear medical guidance

on symptoms, medications, and lab reports.