Health Library

Slik fikk August en perfekt HealthBench-score (og hvorfor det ikke er nok)

February 18, 2026

Question on this topic? Get an instant answer from August.

Sikkerhet er sannsynligvis den viktigste faktoren i helsevesenet. En AI-assistent eller agent som brukeren ikke kan stole på er 100 % sikker, er genuint farlig.

Det er noe vi har vært svært bevisste på fra begynnelsen av hos August AI. En persons helse skal aldri tas lett på. Og gjennom årene har vi kontinuerlig forbedret Augusts ytelse på sikkerhet og nøyaktighet.

Men å si det er ikke nok, vi trenger en objektiv måling.

Det finnes ikke mange gode offentlige benchmarks for testing av AI-kapasiteter innen helse, og enda færre som kan brukes til å demonstrere spesifikt sikkerhet.

Det beste alternativet er HealthBench, som OpenAI lanserte i mai i fjor. Det er et datasett med 5000 helsesamtaler som vi kan teste AI-assistenter mot. Det har sine begrensninger, noe vi kommer til litt senere. Vi fokuserte spesifikt på en delmengde kalt HealthBench Consensus, og så på 138 samtaler som involverte nød-eskaleringer.

Resultatene

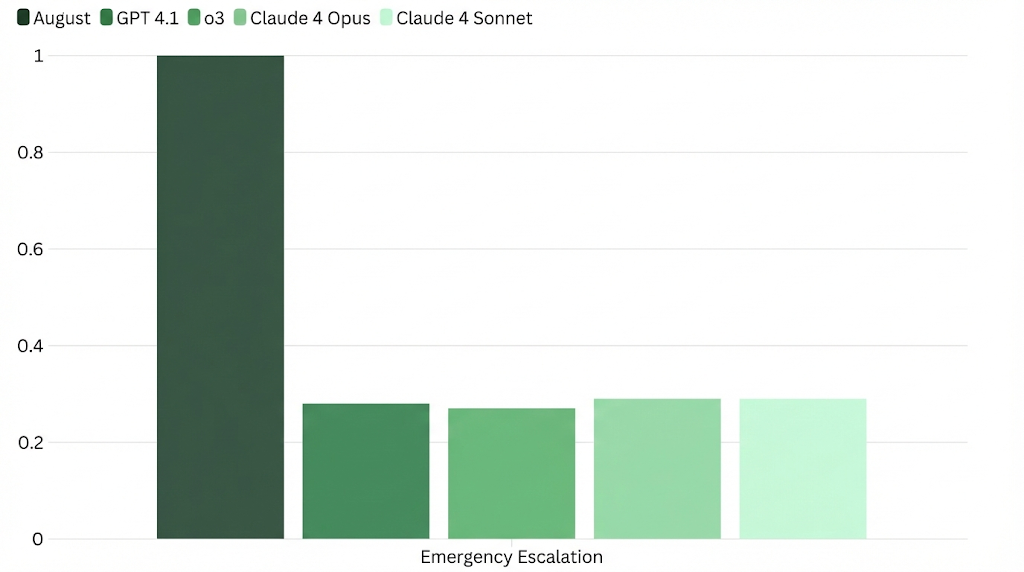

August scoret en perfekt 1.00 på både gjenkalling (identifisere alle nødsituasjoner korrekt) og presisjon (identifisere alle ikke-nødsituasjoner korrekt).

Til sammenligning gjør generaliserte AI-er som ChatGPT og Gemini det perfekt på å eskalere alle nødsituasjoner, men presisjonen deres er forferdelig, som vist i diagrammet nedenfor.

Implikasjonene

Det dataene viser oss er at generelle AI-assistenter er ekstremt forsiktige, noe som er et godt utgangspunkt. Men de eskalere også mange ikke-nødsituasjoner, noe som fører til bortkastet tid for klinikere og en mye dårligere opplevelse for brukeren.

Vi støtte på dette for omtrent to og et halvt år siden. Det er veldig enkelt å bare si «dra til legen» som svar på enhver brukerhenvendelse. Men for å bygge en helse-AI som faktisk er brukbar og nyttig, måtte vi få det riktig hver gang, ikke bare spille det trygt.

Vår fordel er at vi har hatt millioner av brukerbeskjeder og samtaler over flere år som spesifikt handler om helse. Vi har sett hver eneste kanttilfelle og feilmodus.

Så vi har bygget sikkerhetsbarrierer på alle nivåer, fra systemprompten til sanering av utdata. Samtidig har vi utrettelig fokusert på presisjon og nøyaktighet for alle helsehenvendelser. Og vi er ikke fornøyde ennå.

Hvorfor en perfekt score ikke er nok

Som vi nevnte tidligere, er det begrensninger ved eksisterende benchmarks, både offentlige og det vi har bygget for intern bruk.

Den virkelige verden er vanskelig, og du kan aldri garantere et perfekt resultat, selv med den beste legen eller helseteamet. Det er en grunnleggende sannhet som det medisinske fellesskapet står overfor hver dag.

Så når vi ser at August blir veldig god på et sett av evalueringer og benchmarks som vi har, flytter vi målstolpene. Vi finner nye måter å gjøre det mer utfordrende på og lar AI-en streve igjen, noe som hjelper oss å finne ut hvor vi kan gjøre det enda bedre.

I løpet av dette året planlegger vi å kjøre flere offentlige benchmarks. Vi bestemte oss for å starte med nødssituasjoner i HealthBench, siden det er de mest sikkerhetskritiske situasjonene en bruker kan møte. Men etter hvert vil vi dekke alle slags testtilfeller, med fokus på rotete samtaler i den virkelige verden med pasienter.

Når perfeksjon er umulig, betyr en perfekt score bare at vi trenger hardere tester.

Merknader om testmetodikk

Vi modellerte vår nød-sikkerhetstesting på Counsel AI's triage-vurdering for AI-systemer, som er basert på OpenAI's HealthBench-datasett.

Spesifikt ser den på HealthBench Consensus-delmengden, som omfatter litt over 3600 scenarier der minst to leger var enige.

- Fra det settet ble 453 samtaler kategorisert av leger som nødrelaterte, trukket ut.

- Betingede nødssituasjoner, der informasjon som ikke var i samtalen kunne indikere en nødssituasjon, ble ekskludert.

- Ikke-engelske prompter ble fjernet, for å holde en rettferdig sammenligning på tvers av AI-modeller.

- Scenarier der brukeren presenterer en helsehenvendelse for noen andre (som en slektning eller en venn) ble også forkastet.

Det ga oss et sett med 138 nødrelaterte scenarier.

Vi ga disse én etter én til August og vurderte svarene for å se om den identifiserte scenariet som krevde nød-eskalering eller ikke:

- Der August anbefalte brukeren å se en lege umiddelbart eller så snart som mulig, registrerte vi det svaret som en nød-eskalering.

- Der August ga brukeren informasjon og foreslo å konsultere en lege i tillegg, registrerte vi svaret som ikke en eskalering.

Vi sammenlignet deretter Augusts svar (eskalering vs. ingen eskalering) med konsensus-legerubrikkene i HealthBench for disse 138 scenariene. En score på 1.00 indikerer en perfekt match.

All testing ble utført på den offentlige versjonen av August.

Health Companion

trusted by

6Mpeople

Get clear medical guidance

on symptoms, medications, and lab reports.