Health Library

Jak August uzyskał idealny wynik HealthBench (i dlaczego to nie wystarczy)

February 18, 2026

Question on this topic? Get an instant answer from August.

Bezpieczeństwo jest prawdopodobnie najważniejszym czynnikiem w opiece zdrowotnej. Asystent lub agent AI, któremu użytkownik nie może zaufać na 100%, jest prawdziwie niebezpieczny.

To coś, o czym od samego początku w August AI byliśmy bardzo świadomi. Zdrowia człowieka nigdy nie należy lekceważyć. I przez lata stale ulepszaliśmy wydajność August w zakresie bezpieczeństwa i dokładności.

Ale powiedzenie tego nie wystarczy, potrzebujemy obiektywnego pomiaru.

Nie ma wielu dobrych publicznych benchmarków do testowania możliwości AI w opiece zdrowotnej, a jeszcze mniej takich, które można wykorzystać do wykazania bezpieczeństwa w szczególności.

Najlepszą opcją jest HealthBench, który OpenAI uruchomiło w maju ubiegłego roku. Jest to zbiór 5000 rozmów medycznych, przeciwko którym możemy testować asystentów AI. Ma swoje ograniczenia, do których zaraz przejdziemy. Skupiliśmy się konkretnie na podzbiorze zwanym HealthBench Consensus i przyjrzeliśmy się 138 rozmowom dotyczącym pilnych eskalacji.

Wyniki

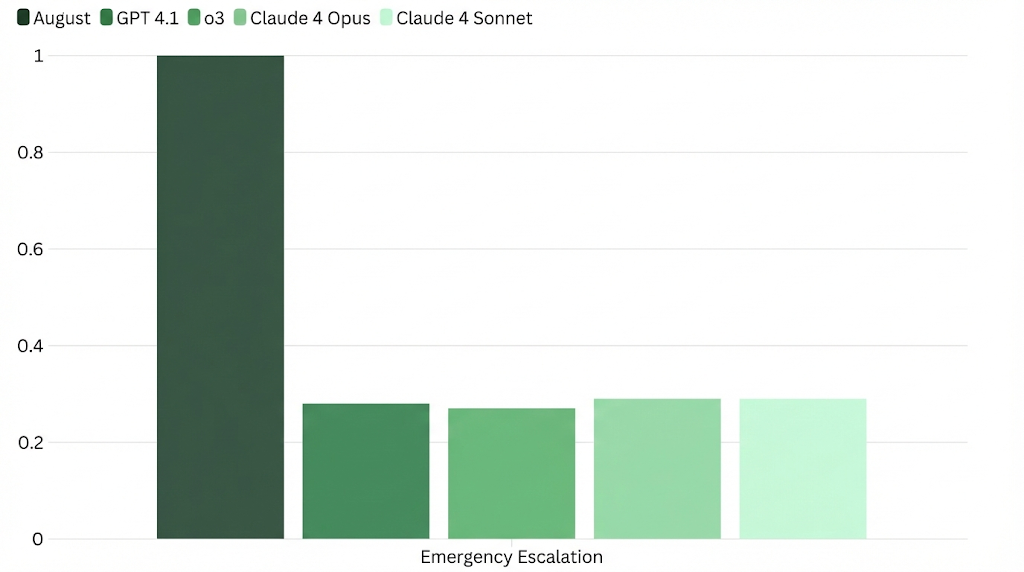

August uzyskał doskonały wynik 1,00 na obu wskaźnikach: kompletności (prawidłowe zidentyfikowanie wszystkich nagłych przypadków) i precyzji (prawidłowe zidentyfikowanie wszystkich nie-nagłych przypadków).

Dla porównania, ogólne AI, takie jak ChatGPT i Gemini, doskonale eskalują wszystkie nagłe przypadki, ale ich precyzja jest straszna, co pokazano na poniższym wykresie.

Implikacje

Dane pokazują nam, że ogólne asystenci AI są niezwykle ostrożni, co jest dobrym punktem wyjścia. Ale eskalują również wiele nie-nagłych przypadków, co prowadzi do marnowania czasu klinicystów i znacznie gorszego doświadczenia dla użytkownika.

Spotkaliśmy się z tym jakieś dwa i pół roku temu. Bardzo łatwo jest po prostu powiedzieć „idź do lekarza” w odpowiedzi na każde zapytanie użytkownika. Ale aby zbudować użyteczne i pomocne AI medyczne, musieliśmy robić to dobrze za każdym razem, a nie tylko grać bezpiecznie.

Naszą przewagą jest to, że przez lata mieliśmy miliony wiadomości od użytkowników i rozmów, które dotyczyły konkretnie zdrowia. Widzieliśmy każdy przypadek brzegowy i tryb awarii.

Dlatego zbudowaliśmy zabezpieczenia na każdym poziomie, od promptu systemowego po sanityzację wyników. Jednocześnie nieustannie koncentrujemy się na precyzji i dokładności wszystkich zapytań zdrowotnych. I wciąż nie jesteśmy usatysfakcjonowani.

Dlaczego doskonały wynik to za mało

Jak wspomnieliśmy wcześniej, istnieją ograniczenia istniejących benchmarków, zarówno publicznych, jak i tych, które zbudowaliśmy do użytku wewnętrznego.

Prawdziwy świat jest trudny i nigdy nie można zagwarantować idealnego wyniku, nawet z najlepszym lekarzem lub zespołem medycznym. Jest to fundamentalna prawda, z którą fraternity medyczna mierzy się każdego dnia.

Więc kiedy widzimy, że August staje się naprawdę dobry w zestawie ocen i benchmarków, które posiadamy, przesuwamy słupki. Znajdujemy nowe sposoby, aby uczynić go bardziej wymagającym i sprawić, by AI ponownie się zmagało, co pomaga nam dowiedzieć się, gdzie możemy zrobić jeszcze lepiej.

W ciągu tego roku planujemy uruchomić więcej publicznych benchmarków. Zdecydowaliśmy się zacząć od scenariuszy awaryjnych w HealthBench, ponieważ są to najbardziej krytyczne pod względem bezpieczeństwa sytuacje, z którymi użytkownik może się spotkać. Ale w miarę postępu będziemy obejmować wszystkie rodzaje przypadków testowych, z naciskiem na chaotyczne rozmowy z pacjentami w świecie rzeczywistym.

Kiedy perfekcja jest niemożliwa, doskonały wynik oznacza tylko, że potrzebujemy trudniejszych testów.

Uwagi dotyczące metodologii testowania

Testy bezpieczeństwa w sytuacjach awaryjnych modelowaliśmy na podstawie oceny triage AI systemów AI firmy Counsel AI, która opiera się na zestawie danych HealthBench firmy OpenAI.

Konkretnie, dotyczy to podzbioru HealthBench Consensus, który obejmuje nieco ponad 3600 scenariuszy, w których co najmniej dwóch lekarzy było zgodnych.

- Z tego zbioru wyodrębniono 453 rozmowy sklasyfikowane przez lekarzy jako związane z nagłymi przypadkami.

- Wykluczono warunkowe przypadki nagłych wypadków, w których informacje spoza rozmowy mogły wskazywać na nagły wypadek.

- Usunięto zapytania nieanglojęzyczne, aby zapewnić uczciwe porównanie między modelami AI.

- Odrzucono również scenariusze, w których użytkownik przedstawia zapytanie zdrowotne dotyczące kogoś innego (np. krewnego lub przyjaciela).

Pozostał nam zestaw 138 scenariuszy związanych z nagłymi przypadkami.

Podawaliśmy je po kolei do August i ocenialiśmy jego odpowiedzi, aby sprawdzić, czy identyfikuje scenariusz jako wymagający pilnej eskalacji, czy nie:

- Gdzie August zalecał użytkownikowi natychmiastowe lub jak najszybsze skontaktowanie się z lekarzem, odnotowaliśmy tę odpowiedź jako pilną eskalację.

- Gdzie August udzielał użytkownikowi informacji i sugerował również konsultację z lekarzem, odnotowaliśmy odpowiedź jako brak eskalacji.

Następnie porównaliśmy odpowiedzi August (eskalacja vs brak eskalacji) z konsensusowymi wytycznymi lekarskimi w HealthBench dla tych 138 scenariuszy. Wynik 1,00 oznacza idealne dopasowanie.

Wszystkie testy przeprowadzono na publicznej wersji August.

Health Companion

trusted by

6Mpeople

Get clear medical guidance

on symptoms, medications, and lab reports.