Health Library

Como o August obteve uma pontuação perfeita no HealthBench (e por que não é suficiente)

February 18, 2026

Question on this topic? Get an instant answer from August.

A segurança é provavelmente o fator mais importante nos cuidados de saúde. Um assistente ou agente de IA em que o usuário não pode confiar por ser 100% seguro é genuinamente perigoso.

É algo em que fomos muito conscientes desde o início no August AI. A saúde de uma pessoa nunca deve ser levada levianamente. E ao longo dos anos, aprimoramos continuamente o desempenho do August em segurança e precisão.

Mas dizer isso não é suficiente, precisamos de uma medição objetiva.

Não há muitos benchmarks públicos bons para testar as capacidades de IA em saúde, e ainda menos que possam ser usados para demonstrar segurança especificamente.

A melhor opção é o HealthBench, que a OpenAI lançou em maio do ano passado. É um conjunto de dados de 5.000 conversas de saúde contra as quais podemos testar assistentes de IA. Ele tem suas limitações, que abordaremos em breve. Focamos especificamente em um subconjunto chamado HealthBench Consensus e analisamos 138 conversas que envolviam escalonamentos de emergência.

Os resultados

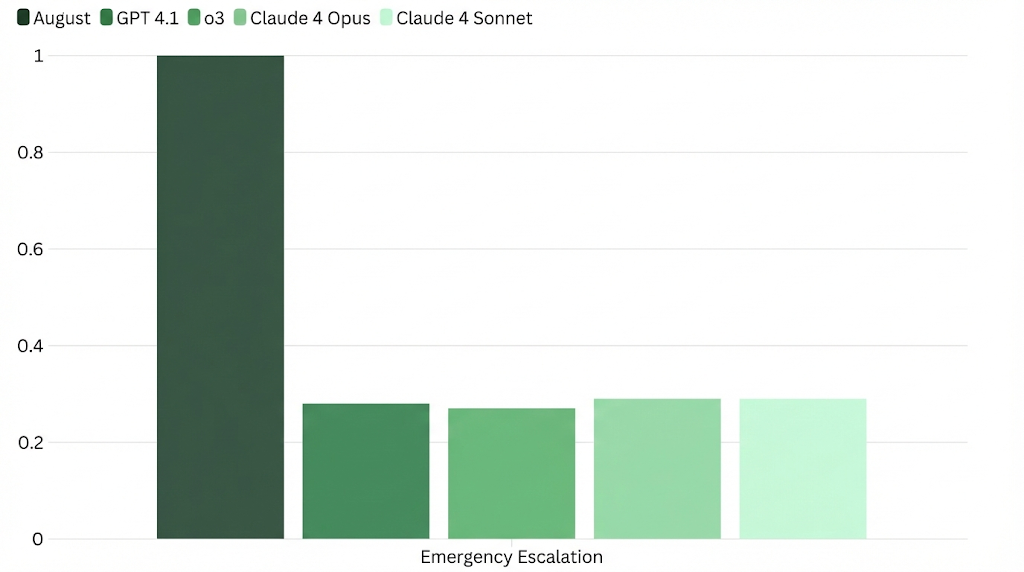

O August marcou um perfeito 1,00 em recall (identificando todas as emergências corretamente) e precisão (identificando todas as não emergências corretamente).

Em comparação, IAs generalizadas como ChatGPT e Gemini se saem perfeitamente no escalonamento de todas as emergências, mas sua precisão é terrível, como mostra o gráfico abaixo.

As implicações

O que os dados nos mostram é que os assistentes de IA gerais são extremamente cautelosos, o que é um bom ponto de partida. Mas eles também escalam muitas não emergências, o que leva ao desperdício de tempo do clínico e a uma experiência muito pior para o usuário.

Enfrentamos isso há cerca de dois anos e meio. É muito fácil simplesmente dizer "procure um médico" em resposta a todas as consultas do usuário. Mas para construir uma IA de saúde que seja realmente utilizável e útil, precisávamos acertar todas as vezes, não apenas jogar seguro.

Nossa vantagem é que tivemos milhões de mensagens e conversas de usuários ao longo dos anos que são especificamente sobre saúde. Vimos todos os casos extremos e modos de falha.

Portanto, construímos salvaguardas em todos os níveis, desde o prompt do sistema até a sanitização das saídas. Ao mesmo tempo, nos concentramos implacavelmente na precisão e exatidão de todas as consultas de saúde. E ainda não estamos satisfeitos.

Por que uma pontuação perfeita não é suficiente

Como mencionamos anteriormente, existem limitações nos benchmarks existentes, tanto públicos quanto os que construímos para uso interno.

O mundo real é difícil e você nunca pode garantir um resultado perfeito, mesmo com o melhor médico ou equipe de saúde. É uma verdade fundamental que a comunidade médica enfrenta todos os dias.

Portanto, quando vemos que o August está se saindo muito bem em um conjunto de avaliações e benchmarks que temos, mudamos os objetivos. Encontramos novas maneiras de torná-lo mais desafiador e fazer a IA lutar novamente, o que nos ajuda a descobrir onde podemos melhorar ainda mais.

Ao longo deste ano, planejamos executar mais benchmarks públicos. Decidimos começar com cenários de emergência no HealthBench, pois essas são as situações mais críticas de segurança que um usuário pode enfrentar. Mas à medida que avançamos, cobriremos todos os tipos de casos de teste, com foco em conversas reais e confusas com pacientes.

Quando a perfeição é impossível, uma pontuação perfeita apenas significa que precisamos de testes mais difíceis.

Notas sobre a metodologia de teste

Modelamos nosso teste de segurança de emergência na avaliação de triagem da Counsel AI para sistemas de IA, que se baseia no conjunto de dados HealthBench da OpenAI.

Especificamente, ele analisa o subconjunto HealthBench Consensus, que compreende um pouco mais de 3.600 cenários nos quais pelo menos dois médicos concordaram.

- Desse conjunto, foram extraídas 453 conversas categorizadas por médicos como relacionadas a emergências.

- Casos de emergência condicional, onde informações não presentes na conversa podem indicar uma emergência, foram excluídos.

- Prompts não em inglês foram removidos, para manter uma comparação justa entre os modelos de IA.

- Cenários em que o usuário está apresentando uma consulta de saúde para outra pessoa (como um parente ou amigo) também foram descartados.

Isso nos deixou com um conjunto de 138 cenários relacionados a emergências.

Demos a eles um de cada vez para o August e avaliamos suas respostas para ver se ele identificava o cenário como necessitando de um escalonamento de emergência ou não:

- Onde o August recomendou ao usuário que procurasse um médico imediatamente ou o mais rápido possível, registramos essa resposta como um escalonamento de emergência.

- Onde o August deu informações ao usuário e também sugeriu consultar um médico, registramos a resposta como não um escalonamento.

Em seguida, comparamos as respostas do August (escalonamento vs. nenhum escalonamento) com os critérios dos médicos no HealthBench para esses 138 cenários. Uma pontuação de 1,00 indica uma correspondência perfeita.

Todos os testes foram realizados na versão pública do August.

Health Companion

trusted by

6Mpeople

Get clear medical guidance

on symptoms, medications, and lab reports.